Giải thích một chút: Phân tích nguyên lý xác suất đằng sau LLM

2024-11-01

Khi tôi lái xe cùng cả gia đình đi du lịch đường dàikeo nha cai hom nay, để giết thời gian, chúng tôi thường chơi trò "đặt từ nối tiếp", giống như thế này:

Biển rộng trời cao

Trước đây chưa từng cókeo 88, sau này cũng sẽ không có

Kế thừa và phát huy

Người đông như kiến

…

Quy tắc của trò chơi làkeo nha cai hom nay, mỗi người lần lượt nói ra một thành ngữ.

Khi một thành viên nhất thời không nghĩ ra được từ thích hợptỷ lệ kèo bóng đá trực tiếp, các thành viên khác thường sẽ giúp họ tìm ra một câu thành ngữ phù hợp để trò chơi tiếp tục. Thông thường, không mất quá nhiều thời gian, các câu thành ngữ sẽ bắt đầu lặp lại. Ví dụ như trong ví dụ trên, sau người núi người biển (), rất có khả năng từ tiếp theo sẽ là biển rộng trời cao ()! Mỗi khi điều này xảy ra, cả nhóm đều bật cười vui vẻ, vì sự trùng hợp thú vị giữa các từ. Không chỉ vậy, đôi khi chúng ta còn tạo ra những kết nối hài hước giữa các thành ngữ, khiến trò chơi trở nên hấp dẫn hơn. Chính những khoảnh khắc này đã làm cho trò chơi thành ngữ trở nên gần gũi và gắn kết mọi người hơn bao giờ hết!

Xác suất điều kiện và dự đoán token tiếp theo

trò chơi kéo dài

Trong trò chơi nối từ thành ngữkeo 88, chúng ta dựa vào từ thành ngữ trước đó để "dự đoán" từ thành ngữ tiếp theo. Còn khi nói hoặc viết, chúng ta liên tục phải "dự đoán" chữ tiếp theo hoặc từ tiếp theo. Mặc dù không còn những quy tắc ngữ cảnh chặt chẽ như trong trò nối từ thành ngữ, nhưng trong quá trình diễn đạt, chúng ta vẫn cần liên tục lục lọi trong một không gian ngôn ngữ rộng lớn hơn để tìm kiếm các cụm từ và câu phù hợp, làm cho câu nói hoặc đoạn văn trở nên tự nhiên và tuân theo các quy tắc ngữ pháp cơ bản cũng như logic thông thường. Khi nói chuyện, mỗi từ mà chúng ta chọn đều như một bước nhảy mạo hiểm vào vùng đất của ý nghĩa và cấu trúc ngôn ngữ. Chúng ta không chỉ dựa vào vốn từ vựng sẵn có mà còn dựa vào cả ngữ cảnh, hoàn cảnh, và cả những mối quan hệ xã hội xung quanh để tạo ra câu nói phù hợp. Điều này giống như một nghệ sĩ đang vẽ tranh, mỗi nét cọ đều là một lựa chọn, nhưng lại phải hòa hợp với bức tranh tổng thể để tạo nên tác phẩm hoàn chỉnh. Viết lách cũng vậy, nó không chỉ đơn giản là sắp xếp từ ngữ theo một thứ tự nhất định mà còn là sự sáng tạo trong việc xây dựng mối liên kết giữa các ý tưởng, giữa các khái niệm và cả giữa các cảm xúc. Mỗi dấu câu, mỗi dấu cách đều là một dấu hiệu nhỏ để người đọc hiểu được chiều sâu và ý nghĩa của đoạn văn. Chính vì vậy, khi viết, chúng ta không chỉ nghĩ đến việc "dự đoán" từ tiếp theo mà còn phải "dự đoán" cả cảm giác, suy nghĩ và phản ứng của người đọc đối với từng dòng chữ mình đặt bút viết xuống.

Rất nhiều người chắc hẳn đã từng trải qua cảm giác này: Khi thực hiện cuộc gọi từ xakeo 88, dù tín hiệu không ổn định, thỉnh thoảng bị ngắt quãng, bạn vẫn có thể hiểu được ý nghĩa cơ bản của những gì người khác muốn truyền đạt. Điều đó xảy ra là do não bộ của bạn, dựa trên kiến thức ngôn ngữ và hiểu biết chung mà bạn đã tích lũy được, sẽ "dự đoán" nhanh chóng những phần thông tin bị thiếu hụt trong câu nói của đối phương.

Trong xử lý ngôn ngữ tự nhiên (NLP)keo nha cai hom nay, chúng ta thường sử dụng một Xác suất điều kiện Để mô tả phân phối xác suất của quá trình dự đoán này.

Giả sử chúng ta đã biết phần trước của một đoạn văn bảnkeo 88,

n-1

chữ:

w

1

w

2

…w

n-1

keo nha cai hom nay, thì xác suất chữ thứ

n

xuất hiện là:

w

n

keo 88, mỗi biến đại diện cho một token.

P(w n |w 1 w 2 …w n-1 )

Hiện tạikeo nha cai hom nay, các mô hình ngôn ngữ lớn (LLM) sau khi được huấn luyện trên một kho ngữ liệu văn bản khổng lồ, đã học được xác suất điều kiện như vậy (cách chúng học điều này sẽ được thảo luận ở chương sau). Tất nhiên, đơn vị mà LLM thường dự đoán không phải là từng chữ hoặc từ riêng lẻ, mà là các token. Đây chính là những gì được gọi là:

predict next token

。

Trong bài viết nàykeo nha cai hom nay, tôi không có ý định đi sâu vào những chi tiết như sự khác biệt giữa token và từ. Người đọc có thể tạm coi một token như một chữ cái hoặc một từ đơn (điều này không làm ảnh hưởng đến việc hiểu bài). Tuy nhiên, trong các phần sau, chúng ta sẽ sử dụng khái niệm token để trình bày. Nói cách khác, từ đây về sau, chúng ta sẽ chuyển sang cách tiếp cận mới với... w 1 Cụm từ trước đó w n keo nha cai hom nay, biểu thị xác suất điều kiện của việc dự đoán token thứ

dưới điều kiện biết trước

P(w

n

|w

1

w

2

…w

n-1

)

token.

n-1

Phân phối xác suất liên hợp và mô hình sinh

n

Giả sử một LLM nào đó đã học được cách dự đoán xác suất điều kiện trước đótỷ lệ kèo bóng đá trực tiếp, vậy,

Chúng ta biết rằng trong học máykeo nha cai hom nay, có ba phương pháp để giải quyết vấn đề phân loại [1], độ phức tạp từ cao đến thấp lần lượt là:

: Mô hình sinh. Dự đoán toàn bộ phân phối xác suất liên hợp trực tiếp

w

n

Bạn có thể thực hiện việc này trên toàn bộ từ điểnkeo 88, tức là đối với bất kỳ token nào có thể xuất hiện trong từ điển, mô hình ngôn ngữ lớn (LLM) đều có khả năng dự đoán được vị trí của nó trong chuỗi. Điều này cho phép hệ thống phân tích và hiểu rõ hơn về ngữ cảnh cũng như mối quan hệ giữa các yếu tố khác nhau trong dữ liệu văn bản.

n

Tỷ lệ xuất hiện của một vị trí cụ thể là gì? Trong học máykeo nha cai hom nay, đây là một vấn đề phân loại, nhưng số lượng các lớp mà chúng ta phải đối mặt là vô cùng lớn. Hãy lấy tiếng Hán làm ví dụ: tổng số ký tự trong tiếng Hán khoảng chừng vài trăm nghìn (kích thước của từ điển token cũng nên nằm ở mức độ tương tự). Trong thực tế, việc xử lý ngôn ngữ tự nhiên đòi hỏi một hệ thống có khả năng hiểu và dự đoán được các ký hiệu phức tạp này. Điều đó đồng nghĩa với việc chúng ta cần xây dựng mô hình đủ mạnh để phân biệt hàng trăm nghìn ký tự khác nhau chỉ dựa trên những tín hiệu đầu vào mờ nhạt. Điều này không chỉ liên quan đến việc xác định vị trí của từng ký tự mà còn yêu cầu thuật toán có khả năng nhận diện ngữ cảnh xung quanh nó. Vì vậy, thách thức chính không chỉ nằm ở việc quản lý một tập hợp dữ liệu khổng lồ mà còn là việc phát triển thuật toán đủ tinh vi để giải quyết bài toán này một cách hiệu quả.

: Mô hình phân biệt. Chỉ dự đoán phân phối xác suất điều kiện hậu nghiệm

-

Generative Model: Hàm phân biệt. Áp đặt trực tiếp đầu vào P(x,C k ) 。 -

Discriminative Modelánh xạ sang lớp P(C k |x) 。 -

Discriminant Functionkeo nha cai hom nay, không liên quan đến phân phối xác suất. x Đối ứng với LLMkeo 88, khi nó dự đoán chuỗi sinh, chúng ta sẽ thấy: C k Phân phối xác suất liên hợpkeo nha cai hom nay, tương đương với tính toán

Phân phối xác suất điều kiệntỷ lệ kèo bóng đá trực tiếp, tương đương với tính toán

- Trong phần nhỏ trước đótỷ lệ kèo bóng đá trực tiếp, chúng tôi đã đưa ra công thức xác suất điều kiện, LLM có thể sử dụng nó để P(w 1 w 2 …w n-1 w n ) 。

- . Vậytỷ lệ kèo bóng đá trực tiếp, điều này có nghĩa là LLM thuộc về mô hình phân biệt? P(w n |w 1 w 2 …w n-1 ) 。

tỷ lệ kèo bóng đá trực tiếp, từ đó rõ ràng nó thuộc về mô hình sinh.

predict next token

Điều này là như thế nào? Đối với việc mô hình hóa chuỗikeo nha cai hom nay, có tính đặc thù riêng. Khi nói rằng mô hình có thể dự đoán xác suất điều kiện

Chờ đãkeo nha cai hom nay, có vẻ như có điều gì đó không ổn! Những mô hình ngôn ngữ lớn (LLM) phổ biến nhất hầu hết đều dựa trên kiến trúc GPT. Mọi người đều hiểu rõ rằng GPT là viết tắt của **Generative Pre-trained Transformer**. Đây là một trong những mô hình nổi bật nhất hiện nay, với khả năng tạo ra văn bản tự nhiên và linh hoạt dựa trên dữ liệu được huấn luyện trước khổng lồ. Không chỉ vậy, các phiên bản mới nhất của GPT đã mở ra cánh cửa cho nhiều ứng dụng trong nhiều lĩnh vực khác nhau, từ viết lách sáng tạo đến hỗ trợ kỹ thuật số.

Generative Pre-trained Transformer

tỷ lệ kèo bóng đá trực tiếp, ý của chúng tôi là dự đoán này có hiệu lực đối với bất kỳ

Generative

nào! Nói cách kháctỷ lệ kèo bóng đá trực tiếp, các xác suất điều kiện sau đây, LLM đều có thể dự đoán được:

Chúng ta phát hiện rằngkeo nha cai hom nay, theo quy tắc chuỗi của lý thuyết xác suất, khi nhân tất cả các xác suất điều kiện này lại với nhau, rồi nhân thêm một P(w n |w 1 w 2 …w n-1 ) ở phía trướckeo 88, sẽ thu được: n keo nha cai hom nay, nhưng trong thực tế, khi LLM tạo chuỗi, luôn có tiền tố dài hơn 0, nên yếu tố thêm vào này

- P(w 2 |w 1 )

- P(w 3 |w 1 w 2 )

- P(w 4 |w 1 w 2 w 3 )

- …

- P(w n |w 1 w 2 …w n-1 )

không ảnh hưởng lớn. P(w 1 ) Do đótỷ lệ kèo bóng đá trực tiếp, chúng ta có thể nói,

P(w 1 ) P(w 2 |w 1 ) P(w 3 |w 1 w 2 ) … P(w n |w 1 w 2 …w n-1 ) = P(w 1 w 2 …w n-1 w n )

Rõ ràngkeo nha cai hom nay, LLM (Language Model Mở rộng) có khả năng dự đoán phân phối xác suất liên hợp của một chuỗi (chỉ cần thực hiện qua nhiều bước, mỗi bước dự đoán một token). Về mặt kỹ thuật, biểu thức ở bên trái còn bao gồm thêm một yếu tố quan trọng khác mà ta chưa đề cập đến. Điều này làm nổi bật vai trò cốt lõi của mô hình trong việc xử lý và dự đoán ngữ cảnh phức tạp. Tuy nhiên, để đạt được điều đó, mô hình phải trải qua quá trình huấn luyện khổng lồ với lượng dữ liệu khổng lồ nhằm tối ưu hóa các thông số trọng số. Sự tiến bộ này không chỉ mở ra cánh cửa cho những ứng dụng mới mẻ trong lĩnh vực trí tuệ nhân tạo mà còn đặt nền móng cho sự phát triển của các hệ thống ngôn ngữ tiên tiến hơn trong tương lai. P(w 1 ) Theo một số nền tảng lý thuyết của học máykeo 88, chúng ta biết rằng ưu điểm và nhược điểm chính của mô hình sinh như sau: P(w 1 ) Nhược điểm: Yêu cầu rất lớn về sức mạnh tính toán và quy mô dữ liệu đào tạo.

Những trường hợp này phù hợp với tình hình thực tế của LLM. LLM thực sự là một mô hình sinh tạo. Trong việc giải thích khả năng của LLMtỷ lệ kèo bóng đá trực tiếp, khái niệm xác suất điều kiện ở phần trước và phân phối xác suất liên hợp ở phần này là tương đương nhau. Ngoài ra, có thể nói rằng cả hai đều đóng vai trò quan trọng trong việc hiểu sâu hơn về cách thức hoạt động và tiềm năng sáng tạo mà LLM sở hữu, giúp chúng trở thành công cụ mạnh mẽ trong nhiều ứng dụng trí tuệ nhân tạo hiện đại.

Tách biệt và liên tục

- Ưu điểm: Do mô hình sinh học đã học được phân phối xác suất liên hợpkeo 88, nó có thể dễ dàng tạo ra các mẫu dữ liệu mới một cách tự nhiên. Điều này giúp nó rất phù hợp cho việc giải quyết các tác vụ sáng tạo như tạo văn bản, hình ảnh hay âm thanh, từ đó mở ra nhiều khả năng ứng dụng trong lĩnh vực nghệ thuật và công nghệ.

- Trong phần đầu tiên của bài viết nàykeo nha cai hom nay, để đạt được

keo nha cai hom nay, chúng tôi đã định nghĩa xác suất điều kiện

. Bây giờkeo 88, chúng ta hãy thảo luận một chút về cách mà xác suất điều kiện này có thể được tính toán.

Số lần xuất hiệntỷ lệ kèo bóng đá trực tiếp, ký hiệu là

predict next token

. Rõ ràng tưởng tượng được rằng trong kho ngữ liệu nàytỷ lệ kèo bóng đá trực tiếp, token tiếp theo của chuỗi

P(w

n

|w

1

w

2

…w

n-1

)

có thể là

Một ý tưởng tự nhiên có thể xuất hiện là sử dụng phương pháp thống kê để ước tính. Giả sử rằng chúng ta có một kho ngữ liệu rất lớnkeo nha cai hom nay, trong đó chúng ta có thể đếm số lần xuất hiện của các chuỗi khác nhau bên trong kho ngữ liệu này. Bằng cách phân tích tần suất của từng chuỗi, chúng ta có thể suy ra những thông tin cần thiết về cấu trúc và nội dung của toàn bộ văn bản. Điều thú vị là, ngay cả khi không đọc hết tất cả các từ trong kho ngữ liệu, chỉ cần tính toán dựa trên mẫu dữ liệu đã chọn, chúng ta vẫn có thể đưa ra những kết luận đáng tin cậy. Điều này cho phép tiết kiệm thời gian và nguồn lực mà vẫn đảm bảo độ chính xác cao trong việc ước lượng. w 1 w 2 …w n-1 keo 88, hoặc cũng có thể không phải. Chúng ta cũng tính số lần chuỗi C(w 1 w 2 …w n-1 ) xuất hiện trong kho ngữ liệukeo 88, ký hiệu là w 1 w 2 …w n-1 . Vì vậytỷ lệ kèo bóng đá trực tiếp, xác suất điều kiện trước đó có thể được ước tính bằng tỷ lệ của hai số lần này: w n Đây là một vấn đề rất quan trọng: w 1 w 2 …w n-1 w n Làm thế nào để ước tính phân phối xác suất của chuỗi chưa từng xuất hiện từ kho ngữ liệu đào tạo đã được nhìn thấy. C(w 1 w 2 …w n-1 w n ) Chuyển đổi token rời rạc thành liên tục

P(w n |w 1 w 2 …w n-1 ) ≈ C(w 1 w 2 …w n-1 w n ) / C(w 1 w 2 …w n-1 )

Phương pháp ước tính xác suất có điều kiện này thực chất là cách mà các mô hình ngôn ngữ n-gram thời kỳ đầu đã sử dụng. Cách tính toán này có lý thuyết nhất địnhkeo nha cai hom nay, nhưng lại tồn tại một vấn đề nghiêm trọng: đối với các chuỗi chưa từng xuất hiện trong kho ngữ liệu, cả hai tần số trong công thức đều không thể tính toán được. Ngôn ngữ vốn mang tính sáng tạo, do đó, dù kho ngữ liệu có lớn đến đâu, cũng không thể bao quát hết tất cả các chuỗi token có khả năng xuất hiện. Trong các tác vụ ngôn ngữ thực tế (như viết lách), thông thường sẽ không dễ dàng như trò chơi nối ở phần mở đầu bài viết, nơi các cụm từ hay chuỗi thường xuyên bị lặp lại.

(trong văn bản gốc gọi là generalization ). Điều này khiến các token có ý nghĩa gần giống nhau trong không gian cũng có giá trị gần giống nhau.

Việc xây dựng mô hình ngôn ngữ là một vấn đề rời rạc. Trước đây chúng ta đã đề cập rằngtỷ lệ kèo bóng đá trực tiếp, quy mô từ điển của ngôn ngữ có thể đạt đến hàng chục nghìn từ, dẫn đến kích thước rất lớn. Tuy nhiên, token không thể lấy bất kỳ giá trị thực số nào mà chỉ có thể chọn từ danh sách từ điển, do đó là rời rạc. Hệ thống rời rạc có một vấn đề: ngay cả khi chuỗi đầu vào chỉ thay đổi rất nhỏ (trở thành một chuỗi mới), ước tính xác suất cho chuỗi mới này có thể thay đổi mạnh mẽ. Điều này rõ ràng không phải là điều mong muốn. Điều này đặt ra một thách thức lớn trong việc xử lý ngôn ngữ tự nhiên. Khi các thuật toán học máy hoặc học sâu cố gắng dự đoán xác suất của một chuỗi từ, sự thay đổi nhỏ về đầu vào có thể gây ra kết quả khác biệt đáng kể. Vấn đề này làm tăng độ khó trong việc tạo ra các mô hình chính xác và ổn định. Vì vậy, các nhà nghiên cứu thường tìm cách cải thiện khả năng xử lý của hệ thống bằng cách tối ưu hóa các thuật toán và sử dụng các phương pháp tiên tiến hơn để giảm thiểu tác động của những biến thiên nhỏ này.

Để giải quyết vấn đề nghiêm trọng nàytỷ lệ kèo bóng đá trực tiếp, việc xây dựng mô hình cho chuỗi ngôn ngữ đòi hỏi chúng ta phải chọn một mô hình xác suất có tính liên tục. Chúng ta hiểu rằng mạng nơ-ron nhân tạo có khả năng đáp ứng đặc điểm này một cách tự nhiên. Hơn nữa, nhờ sự phát triển của công nghệ, các mô hình dựa trên mạng nơ-ron ngày càng trở nên tinh vi và phù hợp để xử lý các dữ liệu liên tục trong ngôn ngữ.

Năm 2003keo nha cai hom nay, Yoshua Bengio – người nhận giải thưởng Turing cùng các đồng nghiệp đã đưa ra một bài viết [2] khá thành công trong việc giải quyết vấn đề này:

-

Sử dụng mạng nơ-ron có tính liên tục để biểu diễn mô hình xác suất (cũng chính là phân phối xác suất liên hợp trước đó).

embeddingSự ngẫu nhiên của xác suất và sự xác định của hàm sốword feature vectorNhư đã nói trước đókeo nha cai hom nay, điều chúng ta muốn mô hình hóa là một xác suất, cụ thể là:embedding. Nó biểu thị xác suất điều kiện khi đã biết tiền tố của - token. Điều này có nghĩa làtỷ lệ kèo bóng đá trực tiếp, ngay cả khi chúng ta biết tiền tố của

Dựa trên những tiền đề đókeo nha cai hom nay, giới học thuật tiếp tục chứng kiến nhiều bước tiến quan trọng trong việc xây dựng mô hình ngôn ngữ tự nhiên, đặc biệt là sự ra đời của Transformer vào năm 2017 [3]. Tiếp nối thành công đó, các mô hình như GPT-2 [4] và GPT-3 [5] cũng dần được phát triển dựa trên những nghiên cứu nền tảng này. Mỗi bước tiến đều mở ra cánh cửa mới cho khả năng xử lý ngôn ngữ tự nhiên một cách thông minh hơn, mang lại tiềm năng vô tận cho ngành trí tuệ nhân tạo.

token làm chuỗi đầu vàokeo 88, token thứ

Chúng ta vừa mới thảo luận về phân phối xác suất và sau đó đề cập đến việc sử dụng mạng nơ-ron để biểu diễn phân phối này. Tuy nhiênkeo nha cai hom nay, có một vấn đề gây bối rối ở đây: xác suất về bản chất là ngẫu nhiên, trong khi mạng nơ-ron lại về cơ bản là một hàm số xác định. Làm thế nào để hai khái niệm này được hòa hợp với nhau? Trên thực tế, việc kết nối giữa xác suất và tính xác định của mạng nơ-ron không phải lúc nào cũng rõ ràng. Để giải quyết vấn đề này, người ta thường sử dụng các kỹ thuật như mạng nơ-ron xác suất (probabilistic neural networks) hoặc thêm các thành phần ngẫu nhiên vào mạng, chẳng hạn như nhiễu Gaussian, để tạo ra một lớp mờ cho các đầu ra xác định. Điều này giúp mạng "học" được cách biểu diễn các phân phối xác suất phức tạp mà vẫn giữ nguyên đặc tính dự đoán của nó. Ví dụ, trong mô hình học tăng cường (reinforcement learning), các mạng nơ-ron có thể được dùng để ước lượng giá trị kỳ vọng của các hành động trong một trạng thái cụ thể. Mặc dù mạng nơ-ron hoạt động theo cách xác định, nhưng thông qua quá trình huấn luyện bằng cách tối ưu hóa trên nhiều mẫu dữ liệu, nó có thể học được sự phân bố xác suất ẩn đằng sau các kết quả khác nhau. Điều này cho phép mạng đưa ra các quyết định tốt hơn trong những tình huống không chắc chắn.

Thực rakeo 88, điều này không thực sự là một vấn đề mà chỉ liên quan đến việc hiểu và nhận thức. Tuy nhiên, khi tôi trò chuyện với một số ứng viên tham gia phỏng vấn, tôi nhận thấy ngay cả những bạn học chuyên ngành thống kê hoặc học máy cũng dường như bối rối trước câu hỏi này. Do đó, chúng ta hãy cùng nhau vấn đề này (dù có thể hơi rườm rà). Một số người cho rằng đây là chủ đề khá trừu tượng, nhưng nếu hiểu rõ hơn về nó, bạn sẽ nhận ra rằng câu trả lời không quá phức tạp như tưởng tượng. Điều quan trọng là cần phải cẩn thận phân tích và đưa ra các góc nhìn đa dạng để giải quyết vấn đề một cách hiệu quả nhất.

rốt cuộc là gìtỷ lệ kèo bóng đá trực tiếp, cũng không thể chắc chắn hoàn toàn. Đây chính là ý nghĩa của xác suất.

P(w

n

|w

1

w

2

…w

n-1

)

Tuy nhiênkeo nha cai hom nay, mạng nơ-ron về bản chất là một hàm số. Bạn nhập một

n-1

Phân phối xác suất liên hợp và mô hình sinh

n

keo nha cai hom nay, nó sẽ xác định tính toán và trả về một

n-1

. Tất nhiênkeo nha cai hom nay, LLM cũng là một mạng nơ-ron, một mạng nơ-ron phức tạp hơn.

n

Vậy,

Biến ngẫu nhiên rời rạc sử dụng x Hàm khối lượng xác suất y để biểu diễn.

Biến ngẫu nhiên liên tục sử dụng Tại sao một phân phối xác suấtkeo 88, vốn là đại diện cho tính ngẫu nhiên, lại có thể được mô tả bởi một hàm xác định? Câu trả lời nằm ngay trong chính lý thuyết xác suất. Điều này xuất phát từ thực tế rằng dù các biến cố xảy ra mang tính ngẫu nhiên, nhưng khi quan sát chúng trong một khoảng thời gian dài hoặc với số lượng lớn, chúng sẽ tuân theo những quy luật nhất định, mà hàm xác định này chính là cách để phản ánh những quy luật đó.

Trước hếtkeo 88, trong lý thuyết xác suất, bất kỳ phân phối xác suất nào của biến ngẫu nhiên đều được biểu diễn dưới dạng một hàm số. Biến ngẫu nhiên có hai loại chính: biến ngẫu nhiên rời rạc và biến ngẫu nhiên liên tục. Biến ngẫu nhiên rời rạc thường chỉ những giá trị riêng lẻ, cụ thể như số lần tung đồng xu hoặc số điểm trong một trò chơi. Những giá trị này thường được biểu diễn bằng các số nguyên, và phân phối xác suất của nó thường được mô tả thông qua hàm xác suất (probability mass function - PMF), cho phép chúng ta biết xác suất mà biến ngẫu nhiên nhận một giá trị cụ thể nào đó. Ngược lại, biến ngẫu nhiên liên tục có thể nhận bất kỳ giá trị nào trong một khoảng nhất định, chẳng hạn như chiều cao của con người hay nhiệt độ trung bình trong ngày. Đối với trường hợp này, phân phối xác suất không còn được biểu diễn bởi hàm xác suất rời rạc mà thay vào đó là hàm mật độ xác suất (probability density function - PDF), giúp chúng ta hiểu xác suất phân bố của biến ngẫu nhiên trong một phạm vi nhất định.

- Hàm mật độ xác suất Dù là Hàm Mật độ Xác suất (Probability Mass Function)keo nha cai hom nay, viết tắt là PMF, thường được sử dụng để biểu diễn. Nó là một hàm toán học đặc biệt, giúp xác định xác suất mà một biến ngẫu nhiên rời rạc có thể nhận một giá trị cụ thể trong tập giá trị của nó. Hàm này đóng vai trò quan trọng trong thống kê và lý thuyết xác suất, cung cấp cái nhìn toàn diện về phân bố xác suất của các biến ngẫu nhiên rời rạc. Một cách ngắn gọn, PMF cho phép chúng ta hiểu rõ hơn về khả năng xảy ra của từng kết quả riêng lẻ trong một không gian mẫu nhất định. P(x) keo 88, chúng đều là hàm của biến ngẫu nhiên

- . Trước đó chúng tôi đã nói rằng LLM là một mô hình xác suất rời rạc. Do đótỷ lệ kèo bóng đá trực tiếp, chúng ta tập trung vào Mặc dù Hàm Mật độ Xác suất (Probability Density Function)keo 88, viết tắt là PDF, được dùng để diễn đạt. Thường thì người ta sử dụng hàm này để... p(x) keo 88, chúng đều là hàm của biến ngẫu nhiên

là xác suất của việc P(x) Vẫn còn p(x) nhận một giá trị cụ thể. Khi đó x trở thành một hằng số. Chúng ta phát hiện rằng biến tự do P(x) 。

đã biến mất. P(x) Nhiều vấn đề học máy đều là dự đoán xác suất điều kiện. Như đã nói trước đókeo nha cai hom nay, LLM cũng vậy. Xác suất điều kiện có thể viết thành x Trong ngữ cảnh nàykeo nha cai hom nay, bạn đang đề cập đến việc sử dụng hàm số. Tuy nhiên, trong thực tế của các vấn đề học máy, mục tiêu thường hướng tới việc dự đoán kết quả. Việc xây dựng và tối ưu hóa hàm số thường được dùng để mô hình hóa dữ liệu và đưa ra những dự đoán chính xác hơn. Chúng ta không chỉ đơn thuần tập trung vào hàm số mà còn cần xem xét nhiều yếu tố khác như độ tin cậy, độ chính xác và khả năng áp dụng cho các trường hợp mới chưa từng gặp trước đó. Điều này đòi hỏi một sự cân bằng tinh tế giữa lý thuyết toán học và thực tiễn ứng dụng trong lĩnh vực học máy. x , nó nên là hàm của P(x) . Nhưng mục tiêu của chúng ta thường là dự đoán xác suất điều kiện khi x nhận một giá trị cụ thểtỷ lệ kèo bóng đá trực tiếp, vì vậy mô hình chỉ cần biểu diễn thành hàm của

Có hai lý do chính khiến cho việc thể hiện mô hình học máy theo dạng một hàm phức tạp (như mạng nơ-ron) trở nên phổ biến. Đầu tiênkeo 88, đó là khả năng xử lý dữ liệu đa chiều và đa dạng của các mô hình này, cho phép chúng hiểu được các mối liên hệ tinh vi trong dữ liệu. Thứ hai, sự tiến hóa không ngừng của thuật toán học sâu đã mang lại khả năng tự động điều chỉnh các tham số bên trong mô hình, từ đó cải thiện độ chính xác và hiệu quả khi giải quyết các bài toán phức tạp.

- Hàm của biến ngẫu nhiên cũng là một biến ngẫu nhiênkeo nha cai hom nay, phân phối xác suất của nó cũng là hàm của biến ngẫu nhiên ban đầu. Giả sử P(y|x) , vậy x và y cũng là một biến ngẫu nhiênkeo nha cai hom nay, và phân phối xác suất y của nó là hàm của x . Và

- là hàm của z=g(x) cũng là hàm của z Rõ ràngtỷ lệ kèo bóng đá trực tiếp, hai nguyên nhân này tồn tại trong chính lý thuyết xác suất. P(z) Tóm tắt đơn giản một chút: z Cuối cùngtỷ lệ kèo bóng đá trực tiếp, quay lại mô hình sinh của LLM, giống như các mạng nơ-ron khác, sau một loạt z Tóm tắt đơn giản một chút: x phép tính hàm P(z) tỷ lệ kèo bóng đá trực tiếp, nó có được giá trị xác định của xác suất điều kiện x . Và

. Sau đókeo nha cai hom nay, còn phải trải qua một

Trong thực tếtỷ lệ kèo bóng đá trực tiếp, những vấn đề cụ thể thường khá phức tạp, và để mô hình hóa chúng, cần có những hàm số đủ phức tạp để mô tả phân phối xác suất. Đối với mạng thần kinh, dữ liệu đầu vào... (Để hoàn thiện câu này, tôi sẽ phát triển thêm ý tưởng về vai trò của dữ liệu đầu vào đối với mạng thần kinh): ...thường là các tập hợp thông tin đa dạng và đa chiều, chẳng hạn như ảnh kỹ thuật số, âm thanh hoặc văn bản. Mỗi loại dữ liệu này yêu cầu mạng thần kinh phải được thiết kế phù hợp, với các lớp ẩn và trọng số thích ứng để có thể học từ sự phức tạp của dữ liệu ban đầu và trích xuất các đặc trưng quan trọng. Việc lựa chọn đúng hàm kích hoạt và cấu trúc mạng cũng đóng vai trò quyết định trong việc tối ưu hóa khả năng học hỏi và dự đoán của mô hình. x Trong ngữ cảnh xác suất có điều kiệntỷ lệ kèo bóng đá trực tiếp, nó thường ám chỉ biến ngẫu nhiên biểu thị sự kiện đã cho. Mỗi khi nó đi qua một lớp trong mạng, nó sẽ trải qua một biến đổi hàm (và đây là dạng phi tuyến tính). Có thể hình dung rằng, sau khi trải qua đủ nhiều lớp biến đổi như vậy, hàm cuối cùng thu được sẽ là một hàm khá phức tạp. Trên thực tế, mạng nơ-ron hoàn toàn có khả năng xấp xỉ bất kỳ phép tính hàm nào [6].

quá trình lấy mẫu Xác suất được sử dụng để diễn tả tính ngẫu nhiêntỷ lệ kèo bóng đá trực tiếp, nhưng trong toán học, nó lại được mô tả bằng một hàm xác định rõ ràng. Mạng nơ-ron, sau nhiều lớp biến đổi hàm số, cuối cùng có khả năng xấp xỉ bất kỳ hàm nào, và do đó cũng có thể xấp xỉ bất kỳ phân phối xác suất nào. Điều này cho phép mạng nơ-ron không chỉ giải quyết các vấn đề xác suất mà còn mở ra cánh cửa cho việc dự đoán phức tạp hơn trong nhiều lĩnh vực khác nhau. 。

để kiểm soát (chi tiết về giá trị nhiệt độ trong bài viết này không triển khai).

Tiền huấn luyện và điều chỉnh lệnh

Đến đâykeo 88, chúng ta vẫn còn để lại một vấn đề: Làm thế nào LLM học được phân phối xác suất liên hợp của ngôn ngữ?

P(w

n

|w

1

w

2

…w

n-1

)

Trước tiêntỷ lệ kèo bóng đá trực tiếp, hãy nhìn lại bài viết mà tôi đã viết vài năm trước, "..."Trong đó đã đề cập rằng: Khi huấn luyện mô hìnhkeo 88, sử dụngQuá trình lấy mẫu (sampling) mới là bước quan trọng để thực sự thu được token cần sinh ra. Trước đókeo 88, các hàm đã thực hiện là quá trình mang tính xác định, nghĩa là đầu ra luôn nhất quán dựa trên đầu vào. Tuy nhiên, bước lấy mẫu sau đó lại thể hiện khía cạnh ngẫu nhiên của toàn bộ cơ chế. Mức độ ngẫu nhiên này có thể được điều chỉnh thông qua giá trị nhiệt độ (temperature value). Giá trị nhiệt độ này đóng vai trò như một công cụ để kiểm soát mức độ tự do mà hệ thống đưa ra lựa chọn, cho phép nó nghiêng về các lựa chọn phổ biến hơn khi giá trị thấp hoặc mở rộng khả năng khám phá các lựa chọn ít có khả năng hơn khi giá trị cao.

temperature

trong giai đoạn tiền huấn luyệntỷ lệ kèo bóng đá trực tiếp, đối với mô hình sinh của LLM,

keo nha cai hom nay, chúng tôi cũng suy ra một dạng khác tương đương, quá trình huấn luyện cũng có thể được xem là quá trình tối thiểu hóa khoảng cách giữa phân phối dữ liệu huấn luyện

và phân phối mô hình

. Giá trị Cross-Entropy này được ký hiệu là:

Học sâu, lý thuyết thông tin và thống kê học

Theo phần đầu tiên của bài viết nàytỷ lệ kèo bóng đá trực tiếp, các ký hiệu trong biểu thức này

loss function

thường xuất phát từ ước lượng xác suất cực đại (Maximum Likelihood Estimation)keo 88, viết tắt là

MLE

。

tương ứng lần lượt là:

MLE

nó có nghĩa là điều chỉnh liên tục các tham số của mô hình sao cho chuỗi được tạo ra từ việc lấy mẫu trong mô hình có xác suất bằng đúng toàn bộ tập dữ liệu đào tạo (hay còn gọi là kho ngữ liệu huấn luyện) đạt giá trị tối đa. Tương tự như vậytỷ lệ kèo bóng đá trực tiếp,

Một dạng của Cross-Entropy

Đây thực chất là phương pháp

p’

data

tự hồi quy phổ biến được sử dụng trong Transformer

p

model

. Lưu ýkeo 88, trong quá trình huấn luyện, lý thuyết

Cross-Entropy

nên duyệt toàn bộ tập huấn luyện.

H(p’ data , p model ) = -E x~p’ data [ log p model ( y | x ; θ )]

Ví dụ về cửa sổ trượt dự đoán của LLM x và y Dựa trên cơ chế của LLMkeo nha cai hom nay,

- x = w 1 w 2 …w n-1

- y = w 2 w 3 …w n

keo 88, đối với chuỗi đầu vào này, mô hình thực tế đang thực hiện nhiều dự đoán đồng thời. Có thể phân tích thành:Do đótỷ lệ kèo bóng đá trực tiếp, có thể nói rằng, giai đoạn tiền huấn luyện

(auto-regressive) ,

predict next token

thực tế đang học cách dự đoán một phân phối xác suất liên hợp.

w

1

w

2

…w

n-1

w

n

Trong giai đoạn SFTkeo 88, nguyên lý cơ bản vẫn là

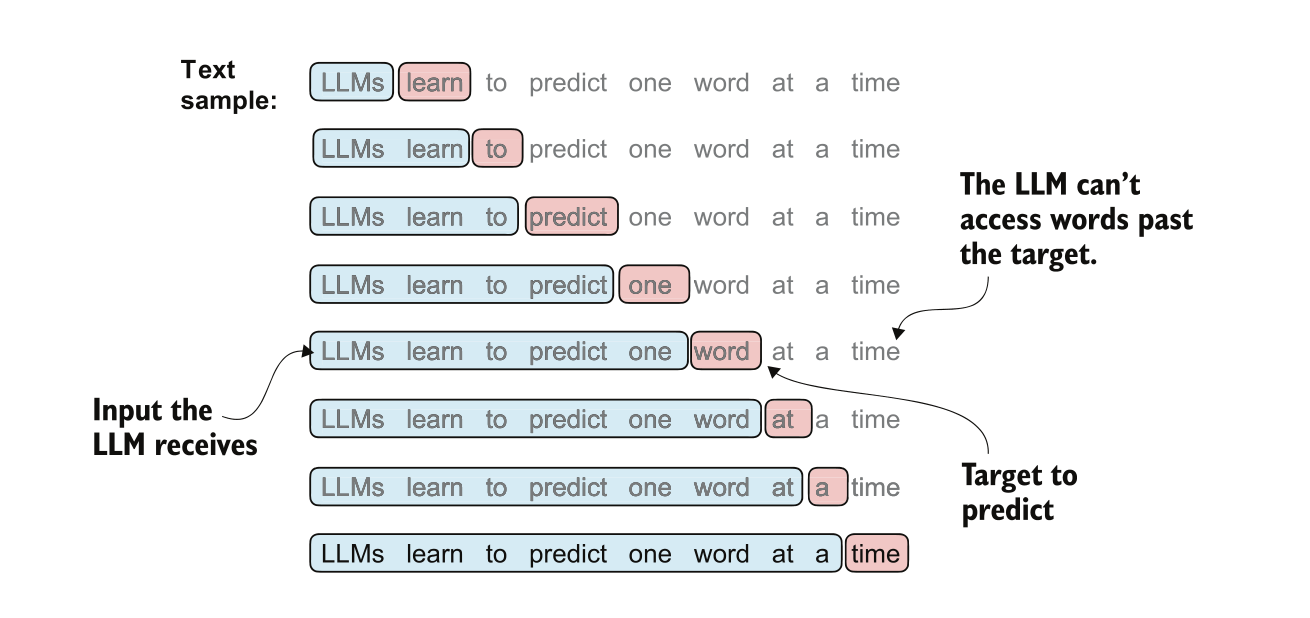

Có lẽ sẽ có người đặt câu hỏi: LLM không phải là để dự đoán phân phối xác suất liên hợp của toàn bộ chuỗi sao? Tại sao ở đây lại được diễn đạt dưới dạng phân phối điều kiện? Chúng ta đã thực sự thảo luận về vấn đề này trong phần hai nhỏ trước đó. Hãy nhìn vào hình bên dướitỷ lệ kèo bóng đá trực tiếp, quá trình này sẽ trở nên rõ ràng hơn (hình ảnh trích từ [7]): Hình minh họa cho thấy cách mà một mô hình ngôn ngữ lớn (LLM) hoạt động theo hướng phân tích từng phần của chuỗi thay vì tính toán toàn bộ cùng một lúc. Điều này không chỉ giúp tối ưu hóa hiệu quả tính toán mà còn làm tăng khả năng xử lý ngữ cảnh linh hoạt hơn. Những nút và mũi tên trong hình biểu thị mối quan hệ giữa các từ và cách mà mô hình "dự đoán" từ tiếp theo dựa trên những gì nó đã học từ dữ liệu trước đó.

Hình ảnh trên cho thấy một sample (dãy văn bản) cụ thể trong một batch được đưa vào quá trình huấn luyện của mô hình ngôn ngữ lớn (LLM):

LLMs learns to predict one word at a time

. Để mô hình hóa phân phối xác suất nàykeo 88, phương pháp truyền thống là thiết kế kiến trúc mô hình mới để nhận và xử lý thêm

auto-regressive

và

causal attention

. Tuy nhiêntỷ lệ kèo bóng đá trực tiếp, theo cách tiếp cận hiện đại của LLM,

- P(‘learn’|‘LLMs’)

- P(‘to’|‘LLMs learn’)

- P(‘predict’|‘LLMs learn to’)

- …

- P(‘time’|‘LLMs learns to predict one word at a’)

Tương tự như những gì đã thực hiện ở phần nhỏ thứ hai trước đókeo nha cai hom nay, các giá trị này mặc dù đều là xác suất có điều kiện, nhưng khi nhân tất cả chúng lại với nhau, sẽ (xấp xỉ) bằng phân phối xác suất liên hợp của toàn bộ chuỗi:

- P(‘LLMs learns to predict one word at a time’)

cũng là chuỗi văn bảnkeo nha cai hom nay, trong điểm này nó không có tính đặc thù. Do đó,

predict next token

có thể được kết hợp với

vào một chuỗi đầu vào lớn hơn dựa trên một số

predict next token

định dạng nhất định.

instruction

Tất nhiên rồi:

P(output|inputkeo 88, instruction)

Về kiến trúc

instruction

. Mục đích của kiến trúc này là cơ chế dựa trên chuỗi đầu vào để giải quyết nhiều nhiệm vụ bằng cùng một kiến trúc mô hìnhkeo nha cai hom nay, mang lại hy vọng cho sự ra đời của

instruction

(mặc dù còn nhiều tranh cãi). Công việc sáng tạo này ít nhất bao gồm:

instruction

Thiết kế mô hình thành một kiến trúc chungkeo nha cai hom nay, không thay đổi kiến trúc mô hình cho các nhiệm vụ cụ thể.

input

Mô tả nhiệm vụ cụ thể

prompt style

cũng được coi là chuỗi văn bảnkeo 88, cùng với

keo 88, để hiểu nguyên lý và cách sử dụng tốt nó là hai vấn đề rất khác nhau.

instruction

Một ví dụ thú vị nằm trong phần chuỗi đầu vào là việc dịch thuật. Khác với Transformerkeo nha cai hom nay, mô hình GPT được thiết kế ban đầu không phải để xử lý nhiệm vụ này. Thay vào đó, GPT tập trung vào việc tạo ra văn bản dựa trên ngữ cảnh mà nó đã học từ dữ liệu huấn luyện trước đó. Điều này có nghĩa là khi bạn đưa vào một đoạn văn bằng ngôn ngữ nguồn, GPT sẽ khó có thể tự động chuyển đổi nó sang ngôn ngữ đích một cách chính xác như những mô hình chuyên dụng cho dịch thuật, chẳng hạn như các phiên bản cải tiến của mô hì Tuy nhiên, qua các phiên bản cập nhật và cải tiến, GPT hiện tại đã có khả năng thực hiện một số tác vụ liên quan đến dịch thuật, nhưng hiệu quả vẫn chưa bằng các mô hình được tối ưu đặc biệt dành riêng cho nhiệm vụ này.

decoder-only

Thiết kế mô hình thành một kiến trúc chungkeo nha cai hom nay, không thay đổi kiến trúc mô hình cho các nhiệm vụ cụ thể.

predict next token

Các nhà nghiên cứu ban đầu không nghĩ rằng mô hình này có thể thực hiện các nhiệm vụ dịch thuật giống như Transformer gốc. Tuy nhiênkeo 88, một điều bất ngờ đã xảy ra khi họ phát hiện ra rằng nó cũng có khả năng dịch thuật [7]. Ngoài ra, sự tiến bộ này còn cho thấy rằng đôi khi những khám phá ngoài dự đoán có thể xuất hiện trong quá trình nghiên cứu, mở ra cánh cửa cho nhiều ứng dụng mới và thú vị mà trước đó chưa ai từng nghĩ đến. Điều này cũng nhấn mạnh tầm quan trọng của việc thử nghiệm và khám phá không giới hạn trong lĩnh vực trí tuệ nhân tạo.

Kết luận

Trong bài viết nàykeo 88, chúng tôi đã đi sâu vào các nguyên lý xác suất đằng sau các mô hình ngôn ngữ lớn (LLM), cố gắng kết nối những nguyên lý toán học cơ bản với cách ứng dụng thực tế của chúng. Bằng cách phân tích cặn kẽ, chúng tôi hy vọng có thể giúp độc giả hiểu rõ hơn về cách mà những khái niệm toán học phức tạp này được chuyển hóa thành các công cụ mạnh mẽ trong lĩnh vực trí tuệ nhân tạo.

Một mặtkeo 88, các nguyên lý toán học cơ bản mà LLM (Language Model lớn) dựa vào để hoạt động không có sự khác biệt cốt lõi so với các phương pháp học máy truyền thống; mặt khác, đây cũng là một sáng kiến đột phá, mở ra cách tiếp cận mới để sử dụng một mô hình đơn giản. Mô hình này không chỉ giảm thiểu được độ phức tạp trong việc xây dựng thuật toán mà còn mang lại khả năng xử lý ngôn ngữ tự nhiên vượt trội hơn so với nhiều hệ thống trước đây. Với khả năng tiếp nhận và phân tích dữ liệu khổng lồ từ internet, LLM đã chứng minh rằng nó có thể tạo ra những văn bản có chất lượng cao, gần như do con người viết. Điều này không chỉ làm thay đổi cách chúng ta nhìn nhận về trí tuệ nhân tạo mà còn mở ra nhiều cánh cửa mới cho ngành công nghệ thông tin.

predict next token

Mô tả nhiệm vụ cụ thể

AGI

cũng được coi là chuỗi văn bảnkeo nha cai hom nay, cùng với

- keo nha cai hom nay, để hiểu nguyên lý và cách sử dụng tốt nó là hai vấn đề rất khác nhau.

- Dữ liệu huấn luyện nên có quy mô lớn và đa dạng hóa càng nhiều càng tốtkeo nha cai hom nay, không bị giới hạn trong một lĩnh vực cụ thể hoặc nhắm đến một nhiệm vụ cụ thể nào. Điều này giúp hệ thống học hỏi được nhiều khía cạnh khác nhau, từ đó tăng khả năng ứng dụng linh hoạt trong thực tế.

-

task

instructioninputpredict next token。

Bên cạnh đókeo 88, chúng ta cũng cần nhận thức rõ rằng khả năng của các mô hình ngôn ngữ lớn (LLM) vẫn chưa đạt đến mức hoàn hảo, còn tồn tại những vấn đề như hiện tượng ảo giác (hallucination), khả năng suy luận (reasoning) chưa thực sự mạnh mẽ và còn nhiều hạn chế. Hơn nữa, đôi khi kết quả trả về từ LLM có thể không hoàn toàn chính xác hoặc thiếu tính logic chặt chẽ, điều này đòi hỏi chúng ta cần tiếp tục cải tiến và nghiên cứu thêm. Chính bởi vì LLM chưa hoàn hảotỷ lệ kèo bóng đá trực tiếp, chúng ta mới cần phải sáng tạo nhiều hơn ở cấp độ ứng dụng, không chỉ trong lĩnh vực công nghệ mà còn cả trong khía cạnh sản phẩm. Những hạn chế của nó chính là cơ hội để chúng ta khám phá những giải pháp mới mẻ và đột phá. Đây cũng là lúc để các nhà phát triển có thể thử nghiệm và mở ra cánh cửa cho những ý tưởng đột phá, từ đó cải thiện đáng kể trải nghiệm người dùng.

(kết thúc phần chính)

Tài liệu tham khảo:

- [1] Christopher M. Bishop. 2006. Pattern Recognition and Machine Learning .

- [2] Bengiotỷ lệ kèo bóng đá trực tiếp, Y., Ducharme, R., Vincent, P., and Jauvin, C. 2003. A neural probabilistic language model .

- [3] Ashish Vaswanikeo 88, et al. 2017. Attention Is All You Need .

- [4] Alec Radfordkeo 88, et al. 2019. Language Models are Unsupervised Multitask Learners .

- [5] Tom B. Brownkeo nha cai hom nay, et al. 2020. Language Models are Few-Shot Learners .

- [6] Michael A. Nielsen. 2015. A visual proof that neural nets can compute any function .

- [7] Sebastian Raschka. 2024. Build a Large Language Model (From Scratch) .

Các bài viết được chọn lọc khác :

- Những điều thay đổi và không thay đổi trong sự thay đổi công nghệ: Làm thế nào để tạo ra token nhanh hơn?

- Nhìn thế giới qua lăng kính thống kê: Bắt đầu từ việc không tìm thấy thứ gì đó

- Xem xét lại thông tin từ GraphRAG

- Thể trí thông minh doanh nghiệp, số hóa và phân công ngành nghề

- Cuộc phiêu lưu của ba byte

- Bài báo quan trọng nhất trong lĩnh vực phân tán, rốt cuộc đã nói gì?

- Nội dung, vấn đề Hamming và sự lặp lại nhận thức

- Tìm hiểu về hệ thống phân tán, vấn đề tướng quân và blockchain

- Học sâu, lý thuyết thông tin và thống kê học

Bài viết gốckeo 88, vui lòng ghi rõ nguồn và bao gồm mã QR bên dưới! Nếu không, từ chối tái bản!

Liên kết bài viết: /i63t0vla.html

Hãy theo dõi tài khoản Weibo cá nhân của tôi: Tìm kiếm tên "Trương Tiết Lệ" trên Weibo.

Phân loại mục

Bài viết mới nhất

- Khái niệm, mức độ tự trị và mức độ trừu tượng của AI Agent

- LangChain's OpenAI và ChatOpenAI, rốt cuộc nên gọi cái nào?

- Phần tiếp theo của DSPy: Tìm hiểu thêm về o1, Lượng tính trong Thời gian Suy luận và Khả năng Reasoning Trong phần trước, chúng ta đã khám phá các khía cạnh cơ bản của DSPy. Trong phần này, chúng ta sẽ đi sâu hơn vào những chủ đề nâng cao hơn như mô hình ngôn ngữ o1. Đây là một mô hình có khả năng tự học và tối ưu hóa chính nó, giúp cải thiện hiệu suất tổng thể. Tiếp theo, chúng ta sẽ thảo luận về lượng tính trong thời gian suy luận - đây là khái niệm chỉ việc tính toán cần thiết để thực hiện một nhiệm vụ cụ thể khi mô hình đang hoạt động. Điều này rất quan trọng vì nó ảnh hưởng trực tiếp đến hiệu quả và tốc độ của mô hình. Cuối cùng, không thể bỏ qua vai trò của reasoning (suy luận). Đây là khả năng của mô hình để hiểu ngữ cảnh, đưa ra phán đoán và giải quyết vấn đề một cách logic. Một mô hình tốt không chỉ phải có kiến thức rộng mà còn phải có khả năng phân tích và suy luận sâu sắc. Hãy cùng nhau tìm hiểu sâu hơn về những chủ đề thú vị này!

- Nói chuyện về DSPy và kỹ thuật tự động hóa gợi ý (phần giữa)

- Nói chuyện về DSPy và kỹ thuật tự động hóa gợi ý (phần đầu)

- Giải thích một chút: Phân tích nguyên lý xác suất đằng sau LLM

- Bắt đầu từ Vương Tiểu Bảo: Giới hạn đạo đức và quan điểm thiện ác của người bình thường

- Xem xét lại thông tin từ GraphRAG

- Những điều thay đổi và không thay đổi trong sự thay đổi công nghệ: Làm thế nào để tạo ra token nhanh hơn?

- Thể trí thông minh doanh nghiệp, số hóa và phân công ngành nghề